引言

2017年,人工智能(AI)浪潮席卷全球,从学术研究、技术突破到产业应用均呈现出前所未有的活力。作为AI技术落地的核心基石,人工智能基础软件的开发状况与发展趋势,直接决定了整个行业的创新速度与应用深度。本报告旨在系统梳理2017年人工智能基础软件领域的现状,并展望其关键发展趋势。

一、 2017年人工智能基础软件开发现状

- 框架生态格局初定,开源主导创新

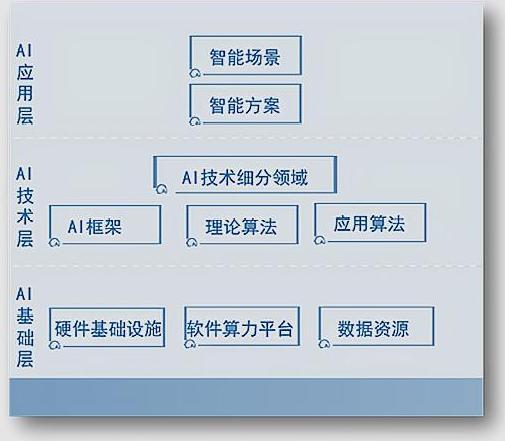

- 双雄并立:谷歌的TensorFlow与Facebook的PyTorch成为最受开发者欢迎的两大深度学习框架。TensorFlow凭借其成熟的工业生产部署能力、丰富的生态系统(如TensorFlow Lite, TensorFlow.js)占据领先地位;而PyTorch则以其动态计算图带来的灵活性与直观的编程体验,在学术界和快速原型开发中迅速崛起,形成了鲜明的差异化竞争格局。

- 多元竞逐:百度的PaddlePaddle、微软的CNTK、亚马逊的MXNet等框架也在特定领域或市场拥有其拥趸,共同构成了活跃而多元的开源生态。开源已成为基础软件创新的最主要模式,极大地降低了技术门槛,加速了全球AI人才的培养与技术的普及。

- 工具链与平台服务日趋完善

- 围绕核心框架,一整套开发、训练、调优、部署的工具链正在快速成熟。自动化机器学习(AutoML)工具开始崭露头角,旨在降低模型设计和超参数调优的复杂性。

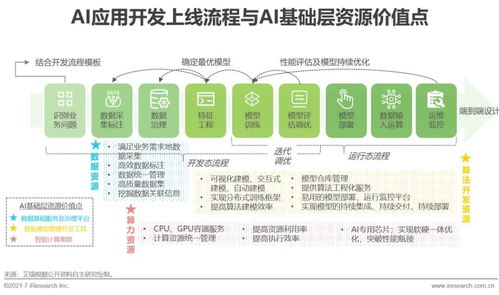

- 云服务巨头(AWS, Google Cloud, Microsoft Azure, 阿里云等)纷纷推出集成的AI平台服务,将计算资源、主流框架、预训练模型和数据管理工具打包,提供从开发到部署的一站式解决方案,使得中小企业也能便捷地利用强大的AI能力。

- 硬件与软件协同优化成为焦点

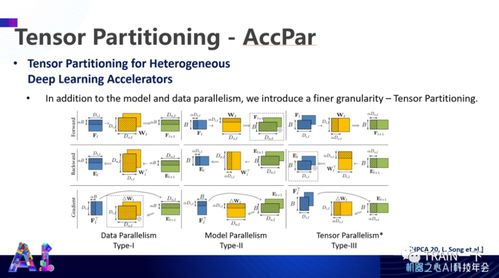

- 随着专用AI芯片(如GPU、TPU、FPGA及各类ASIC)的涌现,基础软件的开发不再局限于算法本身,而是深入到底层硬件。针对特定硬件(尤其是异构计算环境)的编译器、算子库和运行时优化成为关键。例如,英伟达的CUDA及cuDNN库与TensorFlow等框架深度集成,显著提升了模型训练与推理效率。软硬件协同设计(Co-design)成为提升AI计算性能的核心路径。

- 挑战依然显著

- 碎片化与兼容性:框架、硬件平台的多样化带来了碎片化挑战,模型在不同框架间的迁移、在不同硬件上的部署仍存在障碍。

- 开发与运维难度:模型训练对大规模数据与算力的依赖、生产环境部署的复杂性(如模型版本管理、性能监控、持续迭代)对开发者和企业提出了更高要求。

- 安全与可解释性:AI系统的安全性、鲁棒性以及“黑箱”模型的可解释性,开始成为基础软件设计中必须考量的重要因素。

二、 人工智能基础软件开发的核心发展趋势

- 框架演进:走向融合与高层抽象

- 未来框架的竞争将不仅是功能之争,更是生态与易用性之争。预计框架将进一步向高层API和模块化发展,封装底层复杂性,让开发者更专注于业务逻辑。面向移动端和边缘设备的轻量级、高性能推理框架将迎来爆发式增长。

- AutoML与低代码/无代码开发普及

- 自动化机器学习将从研究走向大规模工程应用,成为基础软件的标准配置。结合可视化拖拽界面,“低代码”甚至“无代码”的AI开发平台将使更多非专业开发者(领域专家)能够构建和部署AI模型,极大拓展AI的应用边界。

- 标准化与中间层崛起

- 为解决碎片化问题,行业将加速推动模型表示、接口和部署的标准化。类似于ONNX(开放神经网络交换)格式的中间表示层将扮演越来越重要的角色,成为连接不同框架、不同硬件平台的“桥梁”,实现模型一次训练、多处部署。

- MLOps(机器学习运维)成为关键基础设施

- 随着AI应用规模化,模型的生命周期管理变得至关重要。MLOps理念及相应工具链(涵盖数据管理、实验跟踪、持续集成/持续部署、监控与治理)将深度融入基础软件开发流程,确保AI系统能够像传统软件一样可靠、高效地迭代和运维。

- 聚焦安全、可信与负责任AI

- 基础软件开发将内置更多关于数据隐私(如联邦学习支持)、模型安全(对抗性攻击防御)、公平性检测与可解释性的工具和框架。构建安全、可靠、可信的AI系统将从“可选”变为“必需”。

结论

2017年是人工智能基础软件从技术探索走向大规模产业应用的关键一年。开源框架的繁荣奠定了技术民主化的基石,而云平台与自动化工具则显著降低了应用门槛。基础软件的开发将更加注重易用性、标准化、工程化与安全性,其核心目标是从支持“AI模型研发”转向支撑“规模化AI产品交付与运营”。这一演进过程,将是释放人工智能全部潜能的决定性环节。